Wie können Unternehmen KI-Technologien sinnvoll einsetzen, um Sicherheitsprozesse zu automatisieren, Bedrohungen frühzeitig zu erkennen und ihre Cybersecurity-Strategien zukunftsorientiert weiterzuentwickeln? Wir haben mit Prof. Dr. Norbert Pohlmann über die Zukunft der Cybersecurity gesprochen und warum Unternehmen ihre Sicherheitsstrategien überarbeiten müssen.

Prof. Dr. Norbert Pohlmann

Professor für Cyber-Sicherheit, Leiter des Instituts für Internet-Sicherheit – if(is) an der Westfälischen Hochschule in Gelsenkirchen, Vorstands-vorsitzender des Bundesverbands IT-Sicherheit – TeleTrusT und im Vorstand des Internetverbandes – eco.

Weitere Einblicke auf der Website, dem Marktplatz IT-Sicherheit und auf LinkedIn!

Wie verändert KI das Kräfteverhältnis zwischen Angreifern und Verteidigern – wer profitiert mehr?

Prinzipiell können Angreifer und Verteidiger in gleichem Maße von den Möglichkeiten, die die KI bietet, profitieren. Da Angreifer in der Lage sind, schneller auf sicherheitsrelevante Daten zuzugreifen und sich nicht um Compliance-Anforderungen wie zum Beispiel der Datenschutzgrundverordnung oder dem AI Act kümmern müssen, sind diese deutlich effektiver bezüglich einer gewinnbringenden Nutzung.

Doch das Potenzial, das für eine bessere Verteidigung zur Verfügung steht, ist ebenfalls sehr hoch und sollte deutlich besser genutzt werden, um die Risiken eines Schadens zu reduzieren.

Wie nutzen Angreifer KI heute konkret und was erwartet uns in den nächsten Jahren?

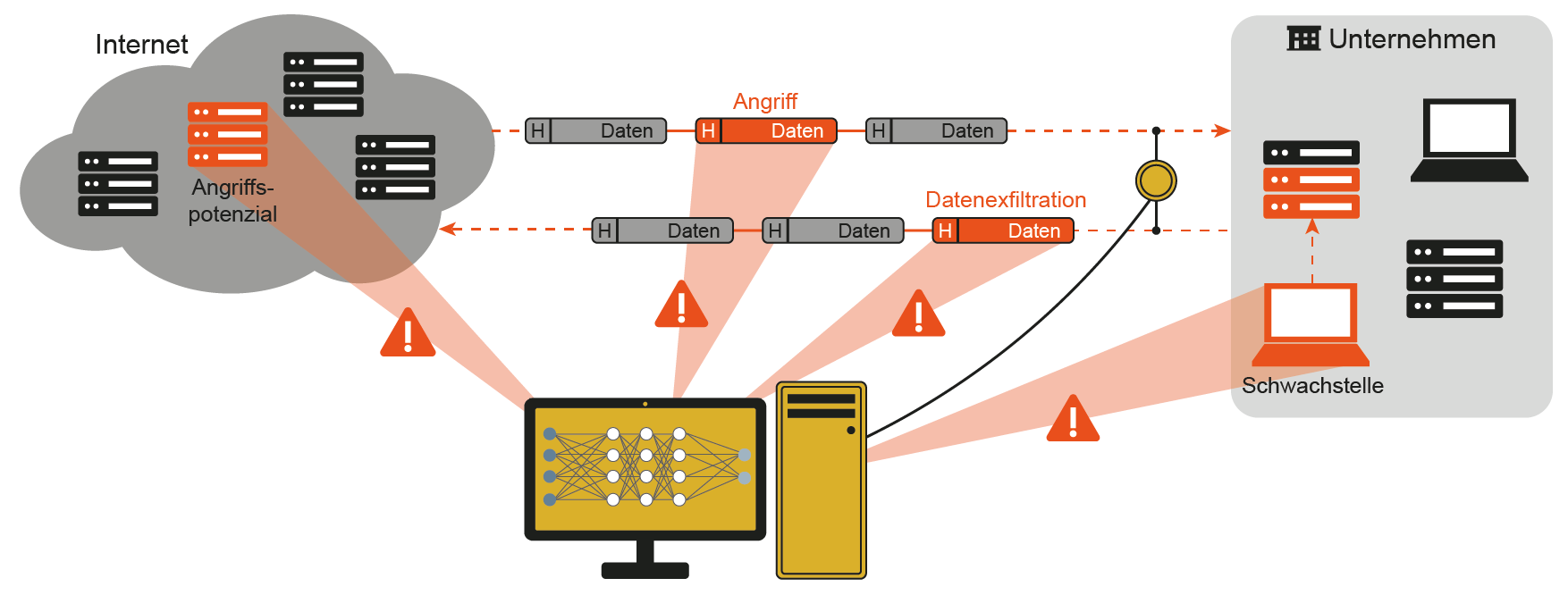

Angreifen haben zum Beispiel eine bestimmte Strategie: Zuerst verfolgen sie die allgemeinen Veröffentlichungen von Schwachstellen, dann scannen sie die Angriffsflächen der Unternehmen, die sie angreifen wollen. Des Weiteren recherchieren sie, wie erfolgreich diese Unternehmen sind, indem sie Umsatz und Gewinn analysieren, um daraus den Erfolg – also zum Beispiel die Höhe der Lösegeldforderung bei Ransomware-Angriffen – prognostizieren zu können.

Eine weitere effiziente Vorgehensweise ist, mittels KI die IT-Sicherheitslösungen der Angriffserkennung zu analysieren, um aufgrund dieser Erkenntnisse unentdeckt angreifen zu können.

Auch das automatisierte Angreifen, etwa durch die Manipulation von Menschen im Bereich Social Media, ist aus Sicht der Angreifer erfolgversprechend. Mit KI werden (künstliche) Fotos von Menschen generiert und Profile so designt, dass diese zu den gewünschten Filterblasen und Echokammern passen, um dann entsprechend zielgerichtet die Menschen in dieser Community zu manipulieren. Auch die dafür notwendigen Informationen lassen sich mit KI einfacher und qualitativ hochwertiger generieren.

In den nächsten Jahren wird eine deutliche Zunahme automatisierter Angriffe auf der Basis von KI zu verzeichnen sein. Dies wird dafür sorgen, dass zunehmend auch die kleineren Unternehmen angegriffen werden.

Welche KI-Werkzeuge sollten Unternehmen jetzt in ihre Sicherheitsstrategie integrieren?

KI sollte in den folgen Sicherheitsfeldern besonders berücksichtigt werden:

Erhöhung der Erkennung von Angriffen im Bereich Netzwerk, Endgeräten, Servern, IoT-Geräte und Cloud-Anwendungen. Aber auch bei der Erkennung von Malware, Spam, Frau-News und Deepfake ist KI sehr hilfreich.

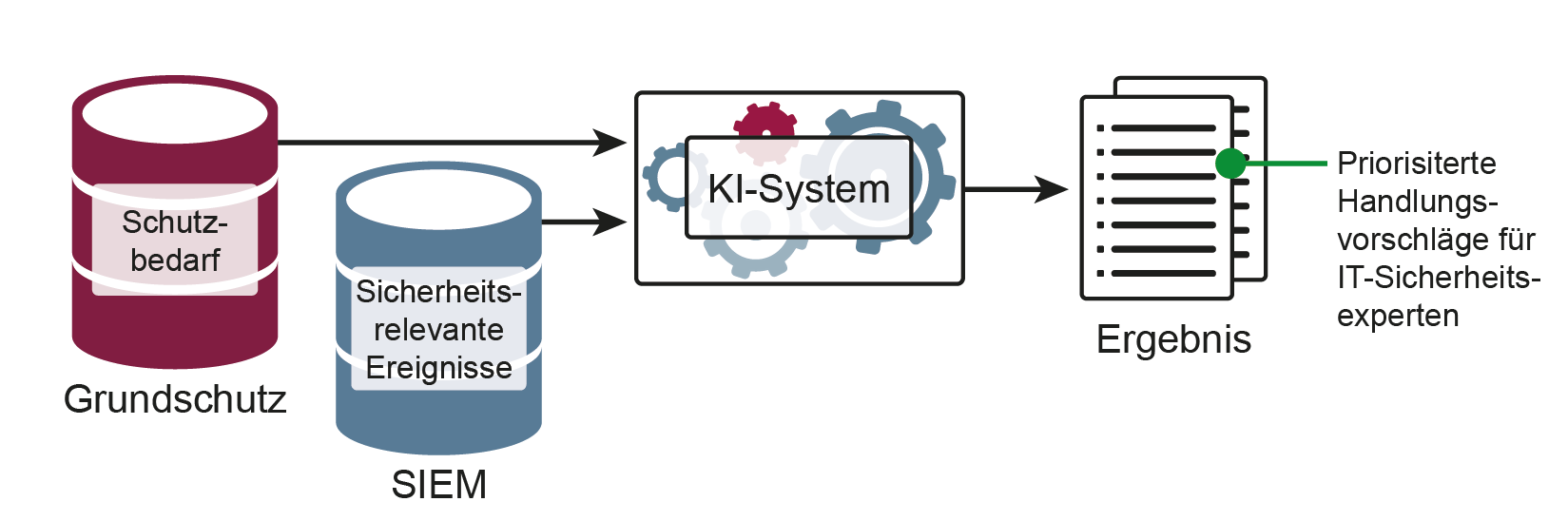

KI hilft zudem bei der Identifizierung und Priorisierung von wichtigen sicherheitsrelevanten Ereignissen zum Beispiel in SIEM-Systemen sowie bei der (Teil-)Autonomie von besonderen Angriffs- und Bedrohungslagen, um automatisiert Angriffsflächen durch die Reduzierung von Regeln umzusetzen, damit das Schadenspotenzial reduziert oder verhindert werden kann.

KI-Systeme selbst werden zur Angriffsfläche – wie gefährlich ist das?

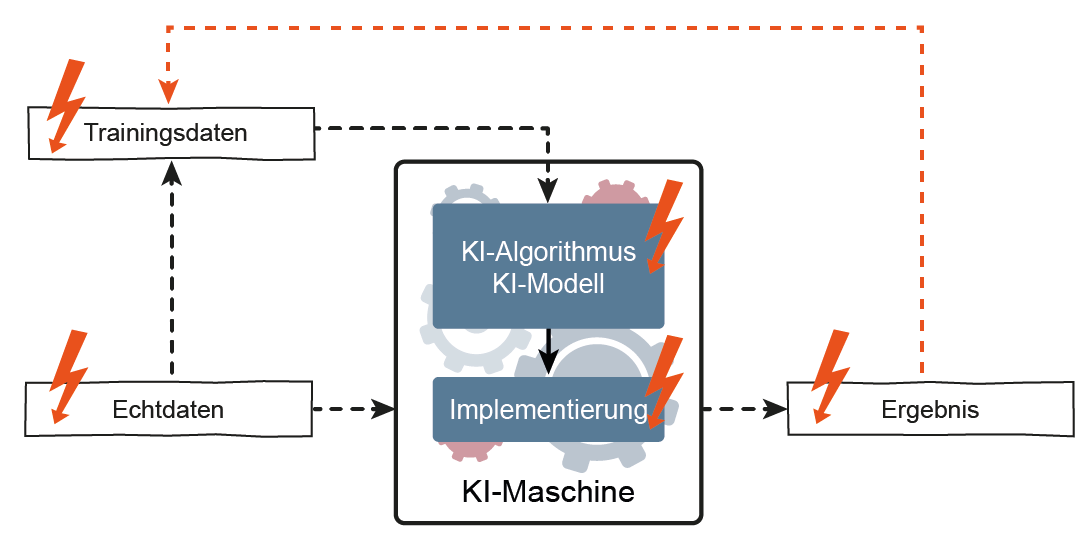

Der Schutz von KI-Anwendungen ist auf allen Ebenen elementar, in denen KI genutzt wird. Angreifer versuchen Trainings- und Inputdaten sowie Algorithmen und Modelle zu manipulieren, um falsche Ergebnisse von KI-Systemen zu provozieren – zum Beispiel im medizinischen Bereich, in der Produktion oder im Kontext des autonomen Fahrens. Das kann zu katastrophalen Folgen führen.

Ein Beispiel ist das Manipulieren der Trainingsdaten (Poisoning Attack), um das genutzte Modell zu beeinflussen, wodurch zum Beispiel die Genauigkeit eines KI-Systems verschlechtert werden kann. Damit lässt sich zum Beispiel erreichen, dass Spam-Mails nicht mehr erkannt werden können, was eine große Gefahr für Unternehmen darstellt. Durch die Manipulation von Eingabedaten (Evasion Attack) können KI-Systeme dazu veranlasst werden, dass eine falsche oder bestimmte Vorhersage/Klassifizierung umgesetzt wird. Dies zeigt die hohe Relevanz, die dem Schutz von KI-Systemen gegen Angriffe beizumessen ist.

Wie verändert KI die Anforderungen an IT-Sicherheitsteams und deren Fachkräfte?

Im Idealfall lassen sich komplexe Routine-Aufgaben durch KI umsetzen, sodass sich die IT-Sicherheitsexperten um die wichtigen Aufgaben kümmern können. Wenn die KI den IT-Sicherheitsexperten Ratschläge zur Verfügung stellt, müssen diese über das notwendige Know-how verfügen, um die Richtigkeit beurteilen zu können und gegebenenfalls andere Maßnahmen zu initiieren, also entgegen den Vorschlägen der KI zu handeln.

Daher werden weiterhin sehr gut ausgebildete IT-Sicherheitsexperten benötigt, die auf einer höheren Ebene in der Lage sind, Entscheidungen treffen zu können und dafür auch Verantwortung zu übernehmen.

Was müssen Regulierung und Politik jetzt tun, damit KI in der Cybersecurity nicht zum Risiko wird?

Wichtig ist, dass die Nutzung von KI in der Cybersecurity für die eigene und gemeinsame Verteidigung gegen die zunehmend intelligenten sowie komplexeren Angriffe genutzt werden. Dies wird auch durch die Regulierung – wie CRA, NIS2 und den AI Act, die in naher Zukunft auf den verschiedenen Ebenen in Kraft treten – forciert. Bei der Umsetzung der Anforderungen ermöglicht der Einsatz von KI auf den verschiedensten Ebenen, die Risiken eines erfolgreichen Angriffs deutlich zu reduzieren.

Claude Mythos – Mehr eine Chance als ein Risiko?

Claude von Anthropic bietet in seiner neuen Version Mythos neben einem Coding-Assistenten auch ein mächtiges Werkzeug zur Identifizierung von Schwachstellen. Doch bei der Menge an Software, die heute genutzt wird, bestehen noch ein paar Herausforderungen für eine umfängliche Analyse. Die Fähigkeiten Schwachstellen zu finden, werden zwar besser, aber aufgrund einer hohen Fehlerrate ist eine manuelle Überprüfung noch notwendig. Hinzu kommt die Herausforderung, dass ein hoher Ressourcenaufwand erforderlich ist, um die eingesetzte Software flächendeckend zu analysieren.

Aber die Chance, diese Fähigkeit zu nutzen und alles zu tun, um Angriffsflächen zu reduzieren, ist ein notwendiger Ansatz, um bei dem steigenden Einsatz von Software die Angreifbarkeit deutlich zu reduzieren. Auch im BSI-Lagebericht wird postuliert, dass der Reduzierung der Angriffsfläche eine hohe Aufmerksamkeit zuteilwerden muss.

Da die auf Perimeter-Sicherheit basierende Verteidigung in der heutigen Zeit überholt ist, werden IT-Systeme benötigt, die deutlich resilienter gegen Angriffe sind, also weniger Schwachstellen besitzen.

Aus diesem Grund ist ein verantwortungsvoller Umgang mit den neuen KI-Analyse-Möglichkeiten essenziell. Es muss dafür gesorgt werden, dass entdeckte Schwachstellen mit den Anbietern gemeinsam priorisiert behoben werden, damit ein neuer Level an IT-Sicherheit erreicht werden kann.

Dieser Übergang birgt sicherlich kurzfristig Gefahren, aber schafft langfristig deutlich mehr Sicherheit für unsere digitale Zukunft.

Die Gelegenheit muss genutzt werden, unsere Angriffsfläche gemeinsam gezielt zu reduzieren.